Hướng dẫn triển khai PoC GenAI trên AWS nhanh, chính xác

Mục lục

Doanh nghiệp bạn muốn thử nghiệm GenAI để ra quyết định nhanh hơn nhưng lại ngại rủi ro về thời gian, chi phí và độ chính xác – một PoC (Proof of Concept) được triển khai đúng cách trên AWS sẽ giúp kiểm chứng ý tưởng rõ ràng trước khi đầu tư lớn.

Bài viết này chia sẻ cách triển khai PoC GenAI trên AWS theo hướng thực tế và có thể triển khai sớm – giúp doanh nghiệp làm đúng, đo được và đủ chắc chắn để chuyển sang giai đoạn production khi cần.

Khám phá “sức mạnh” của GenAI

GenAI có khả năng tạo ra nội dung mới như văn bản, hình ảnh, âm thanh, video và mã lập trình, dựa trên các mẫu (patterns) mà mô hình học được từ dữ liệu huấn luyện.

Foundation models là lớp công nghệ nền tảng phía dưới, cung cấp năng lực tổng quát để bạn tùy biến cho từng nhu cầu cụ thể bằng các kỹ thuật như fine-tuning, prompt engineering và RAG.

GenAI mang lại nhiều lợi ích nổi bật cho doanh nghiệp bao gồm:

- Tạo nội dung.

- Tạo mã và hỗ trợ lập trình.

- Xây dựng giao diện hội thoại.

- Phân tích dữ liệu và tạo insight.

Vai trò của Nhà phát triển GenAI

Là một Nhà phát triển GenAI, bạn cần kết hợp giữa năng lực kỹ thuật và tư duy kinh doanh để xây dựng các giải pháp AI hiệu quả, bao gồm:

Thiết kế giải pháp và kiến trúc hệ thống

Thiết kế các giải pháp tổng thể, có khả năng tích hợp mô hình nền tảng (foundation models) với hệ thống hiện có và các nguồn dữ liệu của doanh nghiệp.

Phạm vi công việc gồm:

- Đánh giá các mô hình kiến trúc khác nhau.

- Lựa chọn mô hình phù hợp.

- Lập kế hoạch triển khai đáp ứng yêu cầu kinh doanh cũng như các ràng buộc kỹ thuật.

Tích hợp và triển khai

Triển khai giải pháp GenAI bằng cách sử dụng các dịch vụ AWS như Amazon Bedrock, Amazon SageMaker AI và các dịch vụ hạ tầng hỗ trợ liên quan.

Phạm vi công việc gồm:

- Cấu hình API.

- Thiết lập pipeline dữ liệu.

- Triển khai hệ thống theo hướng an toàn, có khả năng mở rộng.

Tối ưu hiệu suất

Theo dõi và tối ưu ứng dụng GenAI về hiệu năng, chi phí và độ chính xác.

Phạm vi công việc gồm:

- Tinh chỉnh tham số mô hình.

- Triển khai chiến lược cache.

- Tối ưu việc sử dụng tài nguyên trên toàn bộ “solution stack”.

Bảo mật và tuân thủ

Đảm bảo các giải pháp GenAI đáp ứng yêu cầu bảo mật và các tiêu chuẩn tuân thủ theo quy định.

Phạm vi công việc gồm:

- Thiết lập kiểm soát truy cập phù hợp.

- Mã hóa dữ liệu.

- Ghi log kiểm toán.

- Duy trì quyền riêng tư dữ liệu và quản trị dữ liệu (data governance).

Thiết kế kiến trúc với Foundation Model (FM)

Foundation model là các mạng nơ-ron học sâu quy mô lớn, được huấn luyện trên khối dữ liệu rất lớn và đã thay đổi cách xây dựng hệ thống machine learning hiện nay.

Thay vì phát triển AI từ đầu, bạn có thể dùng foundation model làm nền tảng để phát triển các mô hình ML để phục vụ ứng dụng mới nhanh hơn và tối ưu chi phí hơn.

Một đặc điểm nổi bật của foundation model là khả năng thích ứng cao. Các mô hình này có thể xử lý nhiều tác vụ rất khác nhau với độ chính xác cao dựa trên prompt đầu vào, bao gồm:

- Xử lý ngôn ngữ tự nhiên (NLP).

- Trả lời câu hỏi (Q&A).

- Phân loại hình ảnh.

- Tạo mã (Code generation).

- Hiểu nội dung hình ảnh.

- Chuyển giọng nói thành văn bản.

Các loại mô hình phổ biến

Mô hình đa năng

Được huấn luyện trên dữ liệu đa dạng và rộng – trải dài nhiều lĩnh vực và ngôn ngữ, nên có thể sử dụng linh hoạt cho rất nhiều mục đích khác nhau.

Dữ liệu huấn luyện thường bao gồm văn bản từ sách, website, kho mã nguồn và dữ liệu hội thoại trên nhiều chủ đề. Nhờ đó, các mô hình này có thể xử lý nhiều loại tác vụ mà không cần huấn luyện riêng cho từng lĩnh vực – từ tạo nội dung, tóm tắt văn bản đến hỗ trợ viết code và sáng tạo nội dung.

Ví dụ: Amazon Nova (text, images, video), Claude (Anthropic), GPT (OpenAI), Meta Llama.

Lợi ích: Linh hoạt và đáp ứng nhiều nhu cầu, giảm việc phải dùng nhiều mô hình chuyên biệt khác nhau. Đồng thời cũng tối ưu chi phí hơn cho các hệ thống có nhu cầu xử lý đa dạng.

Mô hình chuyên biệt

Mô hình chuyên biệt được huấn luyện trên dữ liệu theo từng lĩnh vực cụ thể – tập trung vào một ngành, một nhiệm vụ hoặc một tình huống sử dụng nhất định.

Dữ liệu thường được tuyển chọn từ các nguồn chuyên ngành như tạp chí y khoa, văn bản pháp lý hoặc tài liệu khoa học. Nhờ vậy, chúng hoạt động vượt trội trong “sân nhà” của mình vì có thể nắm bắt kiến thức chuyên sâu và thuật ngữ đặc thù mà các mô hình tổng quát đôi khi không hiểu hết.

Ví dụ: BioGPT (tạo văn bản y sinh), AlphaFold (dự đoán cấu trúc protein), LEGAL-BERT (phân tích tài liệu pháp lý), CodeT5 (tác vụ phát triển phần mềm).

Lợi ích: Mang lại độ chính xác và hiệu quả cao hơn cho các bài toán chuyên ngành, hiểu tốt thuật ngữ và ngữ cảnh đặc thù. Điều này giúp giảm sai sót trong những tình huống có mức độ rủi ro cao.

Các phương án tích hợp và triển khai

AWS cung cấp nhiều lựa chọn tích hợp khác nhau, phù hợp với từng mức độ kiểm soát, năng lực chuyên môn và yêu cầu kinh doanh. Hiểu rõ từng lựa chọn sẽ giúp bạn xác định hướng triển khai phù hợp với từng use case cụ thể.

Các phương pháp tích hợp

Tích hợp Amazon Bedrock (API hợp nhất)

Amazon Bedrock cung cấp API hợp nhất để truy cập nhiều mô hình nền tảng (foundation models) mà không cần tự quản lý hạ tầng. Đây là dịch vụ được AWS quản lý hoàn toàn, tính phí theo mức sử dụng dựa trên số lần gọi API và không yêu cầu vận hành hạ tầng.

Lợi ích:

- Triển khai nhanh, rút ngắn thời gian ra mắt.

- Có sẵn các cơ chế bảo mật và tuân thủ.

- Truy cập nhiều mô hình qua một giao diện duy nhất.

- Tự động mở rộng theo nhu cầu sử dụng.

Phù hợp với:

- Đội ngũ chưa có chuyên môn ML sâu.

- Các tác vụ cần làm mẫu nhanh (rapid prototyping).

- Use case tiêu chuẩn.

- Doanh nghiệp muốn tập trung vào logic ứng dụng thay vì hạ tầng

Tích hợp Amazon SageMaker AI (tự triển khai)

Amazon SageMaker AI cho phép triển khai và huấn luyện mô hình tùy chỉnh với mức độ kiểm soát cao. Chi phí được tính dựa trên tài nguyên tính toán và lưu trữ, đồng thời cho phép bạn kiểm soát chi tiết cấu hình triển khai, loại instance và chính sách mở rộng.

Lợi ích:

- Có thể triển khai mô hình tùy chỉnh.

- Hỗ trợ fine-tuning ở mức sâu.

- Cấu hình chuyên biệt để đáp ứng yêu cầu tuân thủ.

- Tích hợp với pipeline ML hiện có.

Phù hợp với:

- Ứng dụng dùng mô hình tùy chỉnh.

- Bài toán cần fine-tuning chuyên sâu.

- Yêu cầu kỹ thuật hoặc tuân thủ đặc thù.

- Trường hợp cần kiểm soát chi tiết hạ tầng ML.

Tích hợp API trực tiếp từ nhà cung cấp

Phương án này là tích hợp trực tiếp với nhà cung cấp mô hình như Anthropic hoặc OpenAI thông qua API gốc của họ, hoặc qua framework như LangChain. Cách làm này giúp truy cập các tính năng mới ngay khi nhà cung cấp phát hành.

Lợi ích:

- Truy cập các khả năng riêng của từng nhà cung cấp.

- Linh hoạt hơn trong cách tích hợp.

- Có thể tiếp cận sớm các tính năng mới.

Nên cân nhắc khi:

- Ứng dụng có yêu cầu gắn với một nhà cung cấp cụ thể.

- Cần tính năng chưa có trên Bedrock.

- Quan hệ hợp tác trực tiếp với nhà cung cấp mang lại lợi thế.

Các phương pháp triển khai

Fine-tuning

Fine-tuning là quá trình điều chỉnh tham số mô hình bằng dữ liệu huấn luyện riêng của bạn để cải thiện hiệu quả cho các tác vụ theo lĩnh vực chuyên biệt.

Cách này cần bộ dữ liệu huấn luyện và kiểm định (training/validation datasets), và thường cần Provisioned Throughput khi triển khai.

Phù hợp với: Ứng dụng mà mô hình tổng quát chưa đạt độ chính xác mong muốn trong lĩnh vực chuyên ngành.

Prompt engineering

Prompt engineering là tối ưu câu lệnh đầu vào để cải thiện chất lượng đầu ra mà không thay đổi mô hình. Đây là phương án tiết kiệm chi phí dựa trên việc tinh chỉnh lặp lại prompt, ví dụ mẫu và hướng dẫn.

Phù hợp với: Trường hợp cần cải thiện kết quả mô hình nhưng chưa cần hoặc chưa phù hợp để fine-tuning.

Retrieval-Augmented Generation (RAG)

Các mô hình nền tảng thường có mốc giới hạn kiến thức theo thời điểm dữ liệu huấn luyện, đồng thời không truy cập được dữ liệu riêng, dữ liệu hiện tại hoặc dữ liệu nội bộ của doanh nghiệp bạn. Nếu không dùng RAG, mô hình có thể:

- Trả lời theo thông tin đã cũ.

- Phản hồi thông tin sai (hallucination).

- Không trả lời được câu hỏi liên quan đến dữ liệu nội bộ tổ chức.

RAG kết hợp mô hình nền tảng với nguồn tri thức bên ngoài để tạo ra câu trả lời chính xác hơn, cập nhật hơn và sát ngữ cảnh hơn. Khi người dùng đặt câu hỏi, hệ thống RAG sẽ truy xuất thông tin liên quan từ kho tri thức, sau đó đưa phần thông tin này vào làm ngữ cảnh cho mô hình nền tảng, giúp câu trả lời bám sát nguồn dữ liệu thực tế.

- Xử lý tài liệu và chia nhỏ (chunking) là phần cốt lõi trong RAG. Bước này tách tài liệu thành các phần nhỏ hơn để dễ xử lý, đồng thời tối ưu kích thước chunk và giữ được ngữ cảnh cần thiết nhằm phục vụ truy xuất hiệu quả.

- Embedding và vector storage cũng là thành phần cốt lõi của RAG. Quy trình này chuyển các đoạn văn bản thành vector toán học, sau đó lưu vào cơ sở dữ liệu chuyên dụng để thực hiện tìm kiếm tương đồng (similarity search) và truy xuất thông tin.

Các lựa chọn triển khai RAG trên AWS:

- Amazon Bedrock Knowledge Bases cung cấp giải pháp RAG được quản lý hoàn toàn, hỗ trợ các lựa chọn vector store như: Amazon OpenSearch Serverless, Amazon OpenSearch Service và Amazon Aurora PostgreSQL.

- Nếu cần tùy biến sâu, bạn có thể tự xây dựng pipeline RAG bằng AWS Lambda, Amazon S3 hoặc cơ sở dữ liệu vector do bạn lựa chọn.

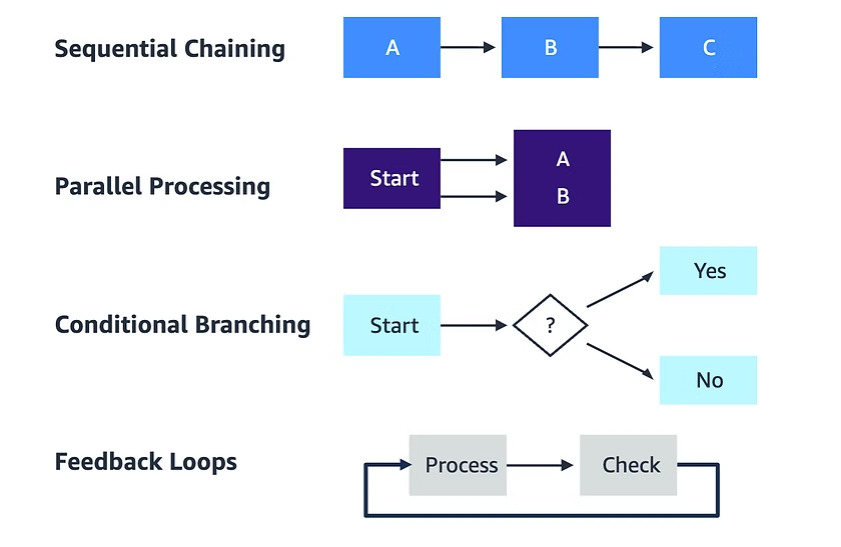

Chuỗi mô hình và điều phối quy trình

Các ứng dụng GenAI phức tạp thường cần kết nối nhiều mô hình hoặc dịch vụ để tạo thành quy trình xử lý nâng cao cho các tác vụ nhiều bước.

Chuỗi mô hình (model chaining) và điều phối (orchestration) giúp bạn xây dựng các hệ thống này bằng cách áp dụng nhiều mẫu triển khai và dịch vụ AWS khác nhau.

Các mô hình điều phối

Các dịch vụ AWS dùng cho điều phối

- AWS Step Functions:

Cung cấp khả năng điều phối workflow trực quan, có sẵn cơ chế xử lý lỗi và thử lại (retry), tích hợp với nhiều dịch vụ AWS, đồng thời hỗ trợ quản lý trạng thái và giám sát.

Phù hợp với các quy trình AI nhiều bước, phức tạp, cần phối hợp giữa nhiều dịch vụ.

- AWS Lambda:

Cung cấp khả năng điều phối bằng hàm serverless, xử lý theo sự kiện và tối ưu chi phí cho các tác vụ chạy không liên tục.

Bạn có thể dùng Lambda để kết nối các dịch vụ AI, xử lý dữ liệu giữa các lần gọi mô hình và triển khai logic tùy chỉnh trong pipeline AI.

- Amazon EventBridge:

Hỗ trợ kiến trúc hướng sự kiện để kết nối nhiều dịch vụ AI và kích hoạt chuỗi mô hình dựa trên sự kiện.

Phù hợp với mô hình kết nối lỏng (loose coupling) giữa các thành phần và các quy trình xử lý bất đồng bộ.

Cách thiết kế PoC cho Amazon Bedrock

Một PoC thành công cần được xác định phạm vi cẩn thận, có tiêu chí thành công rõ ràng và phương pháp đánh giá bài bản. Bạn cần cân bằng giữa việc kiểm chứng kỹ thuật và mục tiêu kinh doanh, đồng thời kiểm soát tốt thời gian và nguồn lực trong suốt quá trình triển khai.

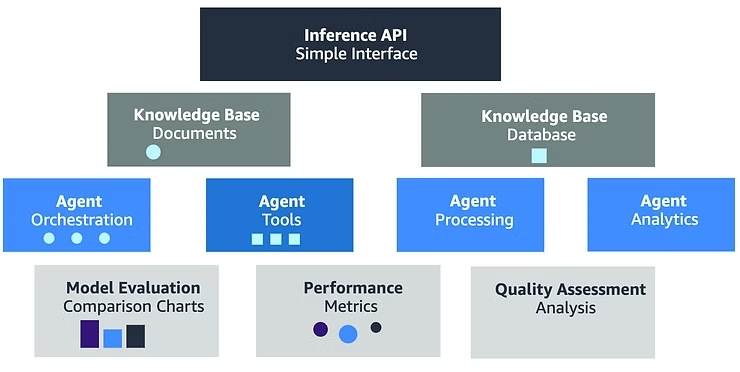

Amazon Bedrock cung cấp đầy đủ tính năng để xây dựng ứng dụng GenAI – từ việc truy cập nhiều mô hình nền tảng khác nhau đến các tính năng nâng cao như Knowledge Bases và Agents. Hiểu rõ chúng sẽ giúp bạn chọn hướng triển khai phù hợp trong quá trình phát triển PoC.

Các loại mô hình trong Bedrock

Có nhiều loại mô hình khác nhau, phù hợp với từng nhu cầu PoC:

- Mô hình tạo văn bản (Text Generation Models).

- Mô hình đa phương thức (Multimodal models, ví dụ Amazon Nova).

- Mô hình Embedding (chuyển văn bản thành biểu diễn vector số, hỗ trợ tìm kiếm ngữ nghĩa, so sánh tài liệu và hệ thống gợi ý).

- Mô hình tạo mã (Code Generation Models).

Tùy chọn tích hợp API

Bedrock có nhiều lựa chọn API với mức độ phức tạp và tính năng khác nhau để đáp ứng từng yêu cầu PoC:

- Inference API: Cho phép truy cập trực tiếp vào các foundation model thông qua REST API. Bạn có thể gửi prompt và nhận phản hồi với thiết lập tối thiểu, rất phù hợp cho PoC và giai đoạn tạo mẫu nhanh.

- Knowledge Bases: Hỗ trợ triển khai mô hình RAG mà không cần tự quản lý vector database hay pipeline embedding. Bạn có thể kết nối tài liệu với foundation model nhanh chóng để tạo ra phản hồi có ngữ cảnh và sát nội dung hơn.

- Agents: Hỗ trợ điều phối các quy trình phức tạp bằng cách kết hợp foundation model với công cụ và API bên ngoài. Tính năng này phù hợp khi bạn muốn xây dựng ứng dụng có thể xử lý nhiều bước công việc và tương tác với hệ thống bên ngoài.

- Model Evaluation: cho phép so sánh nhiều mô hình một cách có hệ thống dựa trên bộ dữ liệu và tiêu chí đánh giá của riêng bạn. Nhờ đó, quá trình chọn mô hình cho PoC trở nên nhanh và có cơ sở rõ ràng hơn.

Triển khai Prompt Engineering

Prompt engineering hiệu quả là yếu tố rất quan trọng để khai thác tối đa năng lực của foundation model trong giai đoạn PoC. Một prompt được viết tốt có thể cải thiện đáng kể chất lượng phản hồi, độ nhất quán và mức độ liên quan – mà chưa cần fine-tuning hay huấn luyện thêm mô hình.

Các phương pháp kiểm chứng kỹ thuật

Quy trình kiểm chứng kỹ thuật gồm 3 nhóm nội dung chính:

- Lựa chọn mô hình có hệ thống để tìm foundation model phù hợp nhất.

- Các mẫu triển khai code đã được kiểm chứng giúp tăng tốc phát triển và bám sát best practices.

- Xác thực và bảo mật chặt chẽ để bảo vệ dữ liệu và sẵn sàng cho triển khai production.

Lựa chọn mô hình

Một quy trình chọn mô hình có cấu trúc rõ ràng sẽ giúp giảm rủi ro và nâng cao khả năng đạt hiệu suất tối ưu cho use case của bạn.

Phân tích yêu cầu

Bắt đầu bằng cách phân tích các yêu cầu cụ thể, gồm:

- Dạng dữ liệu đầu vào/đầu ra (văn bản, hình ảnh, đa phương thức…).

- Kỳ vọng về độ chính xác.

- Ràng buộc về độ trễ (latency).

- Mục tiêu chi phí.

Hãy ghi lại các yêu cầu này rõ ràng để làm cơ sở cho quá trình đánh giá.

Đánh giá so sánh

Sử dụng tính năng Model Evaluation của Amazon Bedrock để so sánh nhiều mô hình theo cách có hệ thống, dựa trên dữ liệu thực tế và tình huống sử dụng thực tế của bạn.

Cách này cho kết quả khách quan hơn so với việc chỉ dựa vào benchmark công bố sẵn.

Kiểm thử lặp (iterative testing)

Thử nghiệm mô hình theo từng vòng với mức độ phức tạp tăng dần:

- Bắt đầu từ các tình huống đơn giản để xác định mức hiệu suất nền.

- Sau đó thêm các edge case và input khó hơn để hiểu rõ giới hạn của mô hình.

Mẫu triển khai code (Code Implementation Patterns)

Việc áp dụng các mẫu code phổ biến giúp tăng tốc phát triển PoC và cung cấp cách tích hợp Amazon Bedrock đã được kiểm chứng.

Các mẫu này giải quyết những tình huống thường gặp và đi kèm best practices về xử lý lỗi và tối ưu hóa.

Mẫu suy luận cơ bản (Basic Inference Pattern)

Triển khai mô hình request-response bằng Bedrock Converse API. Mẫu này phù hợp cho các bài toán như:

- Tạo nội dung văn bản.

- Tóm tắt.

- Hỏi đáp.

Mẫu phản hồi streaming (Streaming Response Pattern)

Với các ứng dụng cần tương tác thời gian thực, hãy dùng phản hồi dạng streaming để hiển thị kết quả từng phần ngay khi mô hình sinh ra. Cách này giúp cải thiện cảm nhận về tốc độ và trải nghiệm người dùng.

Mẫu xử lý hàng loạt (Batch Processing Pattern)

Khi cần xử lý khối lượng dữ liệu lớn, hãy triển khai batch processing để tối ưu throughput và chi phí. Nên bổ sung cơ chế xử lý lỗi và retry để tăng độ ổn định.

Mẫu tích hợp RAG (RAG Integration Pattern)

Với các ứng dụng cần kiến thức chuyên sâu, hãy triển khai RAG bằng:

- Bedrock Knowledge Bases.

- Hoặc hệ thống tìm kiếm vector tùy chỉnh.

Xác thực và bảo mật (Authentication and Security Measures)

Bảo mật cần được đưa vào PoC ngay từ đầu để hình thành thói quen triển khai đúng và giúp chuyển sang production thuận lợi hơn.

Khi áp dụng xác thực, mã hóa và logging ngay trong giai đoạn PoC, sẽ giảm nguy cơ lỗ hổng bảo mật và hỗ trợ tốt hơn cho các yêu cầu tuân thủ.

Các thực hành bảo mật nên áp dụng:

- Dùng IAM Roles theo nguyên tắc phân quyền tối thiểu (least privilege).

- Dùng AWS KMS để mã hóa dữ liệu.

- Dùng AWS CloudTrail để ghi log và theo dõi việc sử dụng API.

Khung kiểm thử hiệu năng (Performance Testing Framework)

Kiểm thử hiệu năng giúp xác nhận rằng triển khai Amazon Bedrock đáp ứng yêu cầu kinh doanh về tốc độ, thông lượng và hiệu quả chi phí.

Một quy trình kiểm thử có hệ thống sẽ giúp phát hiện nút thắt hiệu năng và cơ hội tối ưu trước khi mở rộng triển khai.

Mục tiêu kiểm thử hiệu năng:

- Xác nhận tốc độ phản hồi.

- Đánh giá thông lượng tối đa.

- Kiểm tra hiệu quả chi phí theo khối lượng sử dụng.

- Phát hiện điểm suy giảm hiệu năng khi tăng tải.

Đo thời gian phản hồi (Response Time Benchmarking)

Đo độ trễ

Đo thời gian phản hồi đầu cuối trong nhiều điều kiện khác nhau, gồm:

- Độ dài prompt khác nhau.

- Loại mô hình khác nhau.

- Mức tải đồng thời khác nhau.

Kiểm thử thông lượng

Tăng dần số lượng request đồng thời cho đến khi hệ thống bắt đầu giảm hiệu năng. Bài kiểm thử này giúp bạn hiểu đặc tính scale và lập kế hoạch năng lực phù hợp.

Hiệu năng theo khu vực địa lý

Nếu ứng dụng phục vụ người dùng toàn cầu, hãy kiểm thử từ nhiều AWS Region để đánh giá ảnh hưởng của độ trễ theo vị trí địa lý và tối ưu chiến lược triển khai.

Tối ưu token đầu vào và đầu ra

Đếm token (Token Counting)

Mỗi mô hình có cách đếm token khác nhau, và số lượng token ảnh hưởng trực tiếp đến hiệu năng lẫn chi phí. Bedrock Converse API có trả về số liệu token usage trong response, gồm:

- Token đầu vào.

- Token đầu ra.

Tối ưu prompt

Kiểm thử có hệ thống nhiều cấu trúc prompt khác nhau để tìm điểm cân bằng giữa chất lượng phản hồi và hiệu quả token. Nhiều trường hợp, prompt ngắn gọn và rõ cấu trúc cho kết quả tốt hơn, đồng thời tiết kiệm chi phí hơn.

Kiểm soát độ dài phản hồi

Thiết lập cơ chế kiểm soát độ dài phản hồi theo nhu cầu ứng dụng. Phản hồi dài hơn sẽ làm tăng độ trễ và chi phí, vì vậy cần tối ưu theo mục tiêu thực tế.

Phương pháp ước tính chi phí

Theo dõi chi phí theo thời gian thực là yêu cầu rất thực tế trong các dự án GenAI, đặc biệt ở giai đoạn PoC khi bạn đang thử nghiệm nhiều mô hình và nhiều cách triển khai.

Các hướng ước tính chi phí:

- Phân tích mẫu sử dụng (Usage Pattern Analysis).

- Triển khai theo dõi chi phí bằng AWS Cost Explorer.

- Dự báo chi phí khi mở rộng quy mô (Scaling Cost Projections).

Gợi ý cấu trúc đánh giá PoC để dễ chốt kết quả

Bạn có thể chốt PoC theo 4 nhóm tiêu chí sau để báo cáo dễ hơn:

Kỹ thuật

- Chất lượng phản hồi.

- Độ ổn định.

- Độ trễ.

- Tỷ lệ lỗi.

Nghiệp vụ

- Mức độ đáp ứng use case.

- Mức độ hữu ích với người dùng cuối.

- Khả năng tích hợp vào quy trình hiện tại.

Bảo mật và tuân thủ

- Kiểm soát quyền truy cập.

- Mã hóa.

- Logging / audit trail.

Chi phí

- Chi phí theo request.

- Chi phí theo user/use case.

- Ước tính chi phí khi scale.

Lộ trình triển khai triển khai PoC GenAI trên AWS từ A-Z

Một lộ trình triển khai có hệ thống sẽ giúp bảo đảm quá trình chuyển đổi từ PoC sang production quy mô doanh nghiệp diễn ra hiệu quả.

Lộ trình này cần xử lý đồng thời mức độ sẵn sàng của tổ chức, triển khai kỹ thuật và năng lực vận hành, theo một cách tiếp cận có cấu trúc và kiểm soát rủi ro rõ ràng.

Giai đoạn 1: Thiết lập nền tảng (tuần 1-4)

Đánh giá framework

Thực hiện rà soát kiến trúc theo AWS Well-Architected bằng cách sử dụng Generative AI Lens để đánh giá hiện trạng ban đầu. Xác định các khoảng trống, rủi ro và cơ hội cải thiện phù hợp với khối lượng công việc AI của doanh nghiệp.

Kiểm kê thành phần và chuẩn hóa

Lập danh mục các thành phần AI hiện có và xác định những điểm còn thiếu về chuẩn hóa. Xây dựng bộ tiêu chuẩn dùng chung cho tổ chức đối với các thành phần AI, bao gồm yêu cầu về bảo mật, hiệu năng và vận hành. Thiết lập quy trình quản trị và luồng phê duyệt rõ ràng.

Lựa chọn và thiết lập công cụ

Lựa chọn các dịch vụ và công cụ AWS phù hợp với nguyên tắc Well-Architected. Thiết lập AWS Well-Architected Tool và cấu hình các lens tùy chỉnh theo nhu cầu riêng của tổ chức.

Giai đoạn 2: Phát triển thành phần cốt lõi (tuần 5-12)

Triển khai hạ tầng

Triển khai hạ tầng phục vụ mô hình theo hướng chuẩn hóa, có API nhất quán, cân bằng tải và khả năng tự động mở rộng. Xây dựng hệ thống giám sát và cảnh báo đầy đủ để theo dõi các chỉ số chuyên biệt cho AI.

Bảo mật và tài liệu hóa

Áp dụng các biện pháp kiểm soát bảo mật và quản lý truy cập theo nguyên tắc phân quyền tối thiểu. Xây dựng tài liệu hướng dẫn chi tiết để các nhóm triển khai đồng nhất. Đồng thời phát triển chương trình đào tạo cho đội ngũ phát triển.

Giai đoạn 3: Nâng cao năng lực (tuần 13-24)

Tối ưu và tự động hóa

Triển khai các công cụ tối ưu suy luận (inference) và hệ thống quản lý chi phí. Tự động hóa quy trình triển khai và quản lý vòng đời để giảm thao tác thủ công và tăng tính nhất quán.

Tích hợp và tuân thủ

Tích hợp với các hệ thống doanh nghiệp hiện có và xác thực yêu cầu tuân thủ pháp lý thông qua khả năng kiểm toán. Tối ưu hiệu năng trên toàn bộ thành phần bằng cách áp dụng các thực hành tốt theo Well-Architected.

Giai đoạn 4: Cải tiến liên tục

Phản hồi và đổi mới

Thiết lập quy trình thu thập phản hồi và cải tiến liên tục để ghi nhận bài học thực tế và thúc đẩy tối ưu hóa. Cập nhật các dịch vụ, tính năng mới của AWS khi được phát hành.

Mở rộng quy mô và phát triển lâu dài

Tối ưu hệ thống cho triển khai ở quy mô doanh nghiệp và chia sẻ kinh nghiệm giữa các nhóm. Lập kế hoạch cho các thay đổi công nghệ trong tương lai, đồng thời duy trì định hướng theo nguyên tắc Well-Architected.

Chiến lược giảm thiểu rủi ro khi triển khai PoC GenAI trên AWS

Các hệ thống GenAi khi triển khai vào môi trường vận hành thực tế thường đối mặt với nhiều nhóm rủi ro khác nhau. Vì vậy, cần chủ động nhận diện rủi ro từ sớm và xây dựng chiến lược giảm thiểu phù hợp.

Quản trị rủi ro hiệu quả giúp đảm bảo độ tin cậy của hệ thống, duy trì tính liên tục trong hoạt động kinh doanh, và củng cố niềm tin của các bên liên quan trong suốt vòng đời triển khai.

Đánh giá rủi ro kỹ thuật

Rủi ro kỹ thuật thường liên quan đến hiệu năng hệ thống, độ ổn định của hạ tầng và các thách thức tích hợp, từ đó ảnh hưởng đến khả năng cung cấp dịch vụ và trải nghiệm người dùng.

- Suy giảm hiệu năng ứng dụng GenAI:

Cần triển khai hệ thống giám sát liên tục để phát hiện sớm tình trạng hiệu năng đi xuống và kích hoạt phản ứng tự động.

Nên gắn cơ chế theo dõi cho từng phần của ứng dụng, từ quá trình ingest dữ liệu vào knowledge base, thay đổi prompt, đến các chỉ số request, để xác định chính xác nguồn gây ra biến động.

- Thách thức về mở rộng quy mô và hạ tầng:

Hãy thiết kế kiến trúc mở rộng linh hoạt, có cân bằng tải phù hợp và cơ chế quản lý tài nguyên hiệu quả. Cần kiểm thử kỹ các kịch bản scale và triển khai quản lý năng lực tự động theo biến động nhu cầu thực tế.

- Vấn đề tích hợp và tương thích:

Ưu tiên dùng API tiêu chuẩn và giao diện được tài liệu hóa rõ ràng để giảm độ phức tạp khi tích hợp. Đồng thời, nên xây dựng bộ kiểm thử đầy đủ để xác minh khả năng tương thích giữa các thành phần hệ thống và các phiên bản khác nhau.

Giảm thiểu rủi ro vận hành

Rủi ro vận hành tập trung vào công tác quản lý hàng ngày, lỗ hổng bảo mật và năng lực ứng phó sự cố – đây là các yếu tố ảnh hưởng trực tiếp đến tính liên tục của hoạt động kinh doanh.

- Quản lý tài nguyên và bảo đảm tính sẵn sàng:

Triển khai hệ thống cấp phát và quản lý tài nguyên tự động để duy trì khả năng phục vụ khi tải thay đổi. Thiết kế cơ chế dự phòng và chuyển đổi dự phòng (failover) nhằm bảo đảm hoạt động kinh doanh được duy trì ổn định.

- Lỗ hổng bảo mật và rủi ro tuân thủ:

Áp dụng nhiều lớp kiểm soát bảo mật như mã hóa, quản lý truy cập và bảo mật mạng. Thực hiện đánh giá bảo mật định kỳ, đồng thời duy trì audit đầy đủ để phục vụ yêu cầu tuân thủ.

- Ứng phó sự cố và khôi phục:

Xây dựng quy trình ứng phó sự cố chi tiết với các cấp escalation rõ ràng và quy tắc truyền thông cụ thể. Triển khai khả năng khôi phục tự động cho các tình huống lỗi phổ biến và duy trì quy trình khôi phục thảm họa đã được kiểm thử.

Quản trị rủi ro kinh doanh

Rủi ro kinh doanh bao gồm tác động tài chính, khó khăn trong việc người dùng tiếp nhận hệ thống và các vấn đề liên quan đến hiện thực hóa giá trị – từ đó ảnh hưởng đến kết quả dự án và mục tiêu tổ chức.

- Kiểm soát chi phí và ngân sách:

Thiết lập cơ chế theo dõi chi phí chủ động, đi kèm cảnh báo tự động và giới hạn ngân sách. Xây dựng quy trình tối ưu chi phí để cân bằng giữa yêu cầu hiệu năng và giới hạn tài chính.

- Mức độ tiếp nhận của người dùng và quản lý thay đổi:

Cung cấp chương trình đào tạo và hỗ trợ đầy đủ để thúc đẩy người dùng sử dụng hệ thống. Triển khai quy trình quản lý thay đổi nhằm xử lý sự kháng cự trong tổ chức và giúp quá trình chuyển đổi diễn ra thuận lợi.

- ROI và hiện thực hóa giá trị kinh doanh:

Thiết lập các chỉ số thành công rõ ràng và đánh giá giá trị kinh doanh định kỳ để chứng minh ROI. Triển khai cơ chế thu thập phản hồi nhằm ghi nhận mức độ hài lòng của người dùng và dữ liệu tác động kinh doanh, từ đó hỗ trợ cải tiến liên tục.

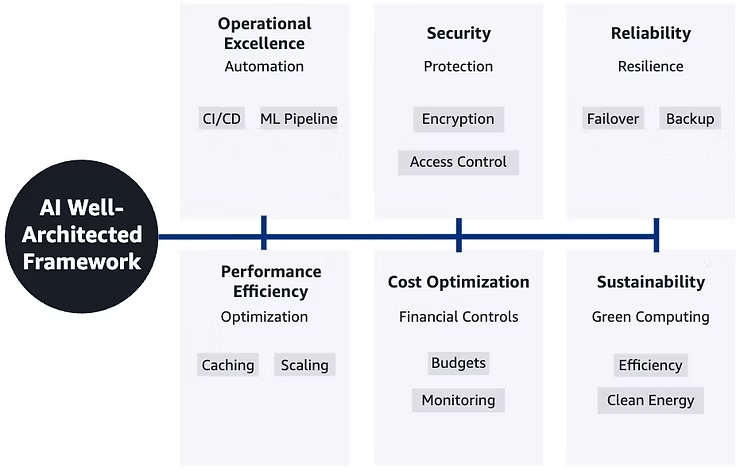

Nền tảng Well-Architected Framework cho ứng dụng Gen AI

Well-Architected Framework rất cần thiết cho các ứng dụng GenAI, vì loại workload này có nhiều thách thức riêng như: hiệu năng mô hình, quyền riêng tư dữ liệu, nhu cầu tính toán lớn và các yêu cầu về AI có trách nhiệm. Generative AI Lens được xây dựng để mở rộng framework này, nhằm xử lý các nhu cầu đặc thù đó.

AWS Well-Architected Framework gồm 6 trụ cột nền tảng, cung cấp hướng dẫn đầy đủ để xây dựng hạ tầng cho ứng dụng theo hướng an toàn, hiệu năng cao, bền bỉ và tối ưu vận hành.

“Đào sâu” hơn: Generative AI Lens mang đến hướng dẫn chuyên biệt để áp dụng các nguyên tắc Well-Architected cho workload AI, tập trung vào những yếu tố mà ứng dụng truyền thống thường không gặp. Lens này bao gồm các nội dung về foundation model, thực hành AI có trách nhiệm và các yêu cầu vận hành riêng cho hệ thống AI.

Sau khi xem xét toàn bộ các yếu tố trên cho triển khai trên môi trường vận hành thực tế, bạn nên xây dựng các template thành phần chuẩn hóa. Những template này cần đóng gói sẵn các “best practices” (các thực hành tốt nhất), cấu hình bảo mật và các mẫu kiến trúc – nhằm bảo đảm việc triển khai đáng tin cậy, nhất quán và có thể lặp lại.

Tiếp theo, hãy xây dựng tài liệu hướng dẫn rõ ràng và khung quản trị phù hợp để bảo đảm các thành phần chuẩn hóa được sử dụng đúng cách và đồng bộ trong toàn tổ chức. Các khung này giúp định hướng triển khai, duy trì tiêu chuẩn chung và thúc đẩy chia sẻ kiến thức, từ đó tăng tốc quá trình áp dụng và giảm lỗi khi triển khai thực tế.

Khi tập trung đầy đủ vào các nội dung trên, bạn sẽ có nền tảng kiến thức vững chắc về triển khai ứng dụng Gen AI theo hướng hiệu quả, an toàn và độ tin cậy cao.

Nếu doanh nghiệp của bạn chưa đủ nguồn lực hoặc kinh nghiệm để tự triển khai PoC GenAI trên AWS – liên hệ RenovaCloud ngay để được tư vấn kiến trúc, chuẩn hóa lộ trình triển khai và rút ngắn thời gian đưa giải pháp vào vận hành thực tế.